Koristite zastareli preglednik. Možda se neće pravilno prikazivati ova ili druge veb stranice.

Trebalo bi da nadogradite ili koristite alternativni preglednik.

Trebalo bi da nadogradite ili koristite alternativni preglednik.

ZorMi

Čuven

- Učlanjen(a)

- 11.08.2002

- Poruke

- 2,856

- Poena

- 875

Moja oprema

- Laptop

- HP Spectre x360 - 15-bl152nr / MS Surface Pro 3 / HP 15-dw2009nm...

- Tablet

- Samsung 8 / Xiaomi MiPad5...

- Mobilni telefon

- Samsung Galaxy A70

- Pametni uređaji

- Samsung Galaxy Watch

Xiaomi MiAir Purifier 3C

Xiaomi Mi Robot Mop...

- Pristup internetu

- Kablovski internet

- Mobilni internet

Koga zanima, a nije dobio pozivnicu...

Za sat vremena počinje OpenAI prezentacija GPT-4 za developere.

Za sat vremena počinje OpenAI prezentacija GPT-4 za developere.

ZorMi

Čuven

- Učlanjen(a)

- 11.08.2002

- Poruke

- 2,856

- Poena

- 875

Moja oprema

- Laptop

- HP Spectre x360 - 15-bl152nr / MS Surface Pro 3 / HP 15-dw2009nm...

- Tablet

- Samsung 8 / Xiaomi MiPad5...

- Mobilni telefon

- Samsung Galaxy A70

- Pametni uređaji

- Samsung Galaxy Watch

Xiaomi MiAir Purifier 3C

Xiaomi Mi Robot Mop...

- Pristup internetu

- Kablovski internet

- Mobilni internet

... mene je dojmilo što prepozna sadržaj nacrtane karikature i objasni šta je tu (ljudima) smešno. 🤭

somebody89

Slavan

- Učlanjen(a)

- 25.08.2014

- Poruke

- 300

- Poena

- 215

Moja oprema

- CPU & Cooler

- 5600X/Scythe Mugen Rev. B

- Matična ploča

- MSI B550 Tomahawk

- RAM

- 2x16GB G.Skill Trident Z Neo 3600 (F4-3600C16D-32GTZNC)

- GPU

- RTX 3070 (Gigabyte Eagle)

- Storage

- Samsung 850 EVO 512GB/WD Blue 3D 1TB

- Zvuk

- Edifier R1700BT

- PSU

- Seasonic FOCUS GX 850W

- Kućište

- NZXT H510

- Monitor

- AOC CU34G2

- Miš & tastatura

- Logitech G305/Keychron K2 V2

- Mobilni telefon

- Samsung Galaxy S21 FE

- Pristup internetu

- Optički internet

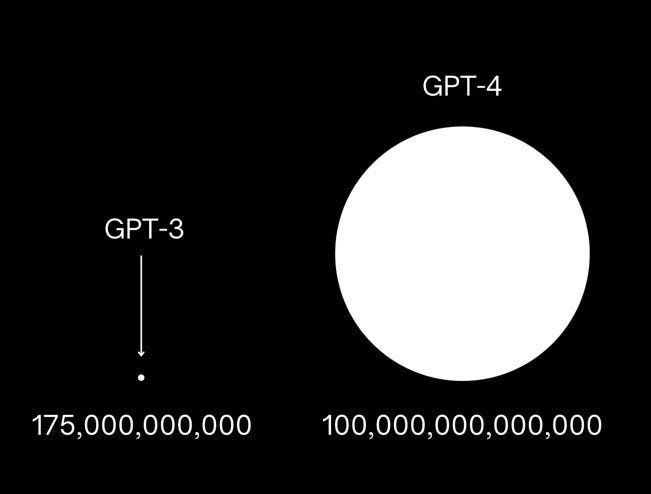

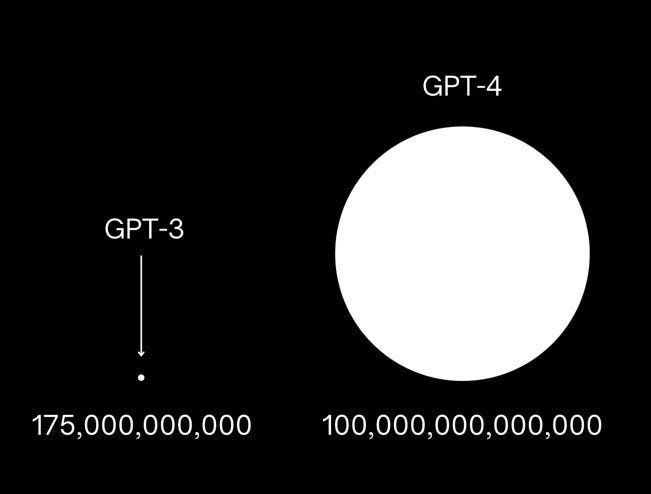

Kao sto je Gary Marcus objasnio, GPT-4 je kvantitativno bolji, ne kvalitativno:

garymarcus.substack.com

garymarcus.substack.com

Ovaj komentar sa clanka koji sam linkovao iznad veoma dobro opisuje u sta se GPT pretvara:

Seems like AI development is becoming more about passing standard tests than tackling the hard problems of intelligence.

Hacks that create a hypeable and sellable product are what's favoured.

A skaliranje (to jest filovanje modela sa sve vecim kolicinama informacija) ne donosi stepen napretka koji obecavaju kreatori. Sto je i ocekivano jer ne mozes korenito promeniti nacin na koji deep learning model radi tako sto ces ga filovati sa sve masivnijum learning setovima. Kao sto sam rekao ranije, najverovatnije ce nam trebati nova revolucija u dizajnu AI modela jer deep learning nije put koji vodi ka AGI (artificial general inteligence). Deluje impresivno i moze biti neverovatno mocan alat u pravim rukama ali tu nema s od inteligencije.

Takodje, tu je i problem potencijalnih opasnosti ako nastavimo da implementiramo deep learning algoritme u sve i svja bez ikakve regulacije (ne zaboravite stari "dobri" moto Facebooka: move fast and break things koji dobro opisuje celokupnu Silicon Valley kulturu, nightmare scenario kada se u jednacinu ubace modeli poput GTP-a). Na primer, Microsoft je otpustio celokupan AI ethics tim jer liberalni kapitalizam ne voli ikakve ograde u svojoj nezajazljivoj gladi za profitom i market share-om, sto je veoma opasno na duge staze. Charles Stross i Ted Chiang objasnili, jos 2017.:

https://www.buzzfeednews.com/article/tedchiang/the-real-danger-to-civilization-isnt-ai-its-runaway

Tu su i Gary Marcus i Stuart Russell (jedan od pionira modernog AI pristupa) koji su nedavno gostovali kod Sama Harrisa:

www.samharris.org

www.samharris.org

Za kraj, procitajte i knjigu Stuarta Russella (tamo sam i nasao dva linka koja sam podelio iznad). Veoma dobro stivo za citati trenutno: Human Compatible: Artificial Intelligence and the Problem of Control

Nevezano za regulisanje deep learning algoritama, ovi Holandjani imaju (po meni) mnogo bolju polaznu ideju u odnosu na GPT i klonove:

Ni njihov pristup vrv nece dovesti do AGI jer mozak funckionise tako sto ucenje ojacava konekcije izmedju neurona, kojih u ljudskom mozgu ima 100 triliona a mi, za sada, nemamo materijal koji se moze ponasati kao neuroni koliko je meni poznato. Ali, u svakom slucaju vise cemo napredovati ako pokusamo da fizicki simuliramo rad neurona umesto koriscenja virtuelnih neuronskih mreza koje veze nemaju sa onim sto se desava u nasem "wetware-u."

GPT-4’s successes, and GPT-4’s failures

How GPT-4 fits into the larger tapestry of the quest for artificial general intelligence

Ovaj komentar sa clanka koji sam linkovao iznad veoma dobro opisuje u sta se GPT pretvara:

Seems like AI development is becoming more about passing standard tests than tackling the hard problems of intelligence.

Hacks that create a hypeable and sellable product are what's favoured.

A skaliranje (to jest filovanje modela sa sve vecim kolicinama informacija) ne donosi stepen napretka koji obecavaju kreatori. Sto je i ocekivano jer ne mozes korenito promeniti nacin na koji deep learning model radi tako sto ces ga filovati sa sve masivnijum learning setovima. Kao sto sam rekao ranije, najverovatnije ce nam trebati nova revolucija u dizajnu AI modela jer deep learning nije put koji vodi ka AGI (artificial general inteligence). Deluje impresivno i moze biti neverovatno mocan alat u pravim rukama ali tu nema s od inteligencije.

Takodje, tu je i problem potencijalnih opasnosti ako nastavimo da implementiramo deep learning algoritme u sve i svja bez ikakve regulacije (ne zaboravite stari "dobri" moto Facebooka: move fast and break things koji dobro opisuje celokupnu Silicon Valley kulturu, nightmare scenario kada se u jednacinu ubace modeli poput GTP-a). Na primer, Microsoft je otpustio celokupan AI ethics tim jer liberalni kapitalizam ne voli ikakve ograde u svojoj nezajazljivoj gladi za profitom i market share-om, sto je veoma opasno na duge staze. Charles Stross i Ted Chiang objasnili, jos 2017.:

https://www.buzzfeednews.com/article/tedchiang/the-real-danger-to-civilization-isnt-ai-its-runaway

Tu su i Gary Marcus i Stuart Russell (jedan od pionira modernog AI pristupa) koji su nedavno gostovali kod Sama Harrisa:

Sam Harris | #312 - The Trouble with AI

Sam Harris speaks with Stuart Russell and Gary Marcus about recent developments in artificial intelligence and the long-term risks of producing artificial general intelligence (AGI).

Za kraj, procitajte i knjigu Stuarta Russella (tamo sam i nasao dva linka koja sam podelio iznad). Veoma dobro stivo za citati trenutno: Human Compatible: Artificial Intelligence and the Problem of Control

Nevezano za regulisanje deep learning algoritama, ovi Holandjani imaju (po meni) mnogo bolju polaznu ideju u odnosu na GPT i klonove:

Ni njihov pristup vrv nece dovesti do AGI jer mozak funckionise tako sto ucenje ojacava konekcije izmedju neurona, kojih u ljudskom mozgu ima 100 triliona a mi, za sada, nemamo materijal koji se moze ponasati kao neuroni koliko je meni poznato. Ali, u svakom slucaju vise cemo napredovati ako pokusamo da fizicki simuliramo rad neurona umesto koriscenja virtuelnih neuronskih mreza koje veze nemaju sa onim sto se desava u nasem "wetware-u."

Poslednja izmena:

defo

Cenjen

- Učlanjen(a)

- 10.09.2020

- Poruke

- 327

- Poena

- 115

šta je to?hard problems of intelligence.

možda se misli na Čalmersov hard problem of consciousness, koji nije povezan s inteligencijom, već s osećanjima koji sačinjavaju bivstvovanje; odakle proizilazi to - ja sam

u biti, pojam inteligencije, je prilično jasan, dok je razumevanje (samo)svesti, verovatno, najkompleksniji problem poznat čoveku, te ne treba kod diskusije o AI, mešati ta dva - ovo prvo, možemo (očigledno) da reprodukujemo, dok za svest, ni ne znamo šta je

somebody89

Slavan

- Učlanjen(a)

- 25.08.2014

- Poruke

- 300

- Poena

- 215

Moja oprema

- CPU & Cooler

- 5600X/Scythe Mugen Rev. B

- Matična ploča

- MSI B550 Tomahawk

- RAM

- 2x16GB G.Skill Trident Z Neo 3600 (F4-3600C16D-32GTZNC)

- GPU

- RTX 3070 (Gigabyte Eagle)

- Storage

- Samsung 850 EVO 512GB/WD Blue 3D 1TB

- Zvuk

- Edifier R1700BT

- PSU

- Seasonic FOCUS GX 850W

- Kućište

- NZXT H510

- Monitor

- AOC CU34G2

- Miš & tastatura

- Logitech G305/Keychron K2 V2

- Mobilni telefon

- Samsung Galaxy S21 FE

- Pristup internetu

- Optički internet

pojam inteligencije, je prilično jasan

Pojam je jasan ali nemamo pojma kako inteligencija funcionise, to jest nemamo pojma o njenim mehanizmima na kognitivnom nivou.

I ne, ne mozemo da reprodukujemo inteligenciju. Ponovo, deep learning algoritmi nemaju veze sa inteligencijom.

- Učlanjen(a)

- 12.05.2012

- Poruke

- 510

- Poena

- 195

Мене по мало плаши ово све.

Чуо сам и раније за ово, али један дан када сам дошао кући жена ми је ”отворила очи”. Она је биоинжењер и ради у лабораторији у универзитетској болници у Ослу. Њена колегиница је добила посао а ”пропарно писмо” јој је писао ”осумњичени”... Одушевила се када је читала, како је то све лепо сложено и укомпоновано.

Онда кренем ја да користим и сконтам да је мултијезичан.

Живим и радим у Ослу, Норвешкој као пројектни инжењер и свакодневно се шаљу многобројни мејлови. Норвешки језик познајем на завидном нивоу, али то неко ређање речи у реченици они раде дригачије од нас, такође и коришћење ”фенси” речи.

Сада кад год шаљем неки компликованији и дужи мејл, ”пропустим” га кроз горе поменутог...Резултат сваки пут одушеви.

П.С. Каже ми један млађи колега који је притом и студент да је на универзитету у Ослу већ дат ”алат” професорима који са 99% тачношћу утврђује да ли је chatGPT писао есеј.

Чуо сам и раније за ово, али један дан када сам дошао кући жена ми је ”отворила очи”. Она је биоинжењер и ради у лабораторији у универзитетској болници у Ослу. Њена колегиница је добила посао а ”пропарно писмо” јој је писао ”осумњичени”... Одушевила се када је читала, како је то све лепо сложено и укомпоновано.

Онда кренем ја да користим и сконтам да је мултијезичан.

Живим и радим у Ослу, Норвешкој као пројектни инжењер и свакодневно се шаљу многобројни мејлови. Норвешки језик познајем на завидном нивоу, али то неко ређање речи у реченици они раде дригачије од нас, такође и коришћење ”фенси” речи.

Сада кад год шаљем неки компликованији и дужи мејл, ”пропустим” га кроз горе поменутог...Резултат сваки пут одушеви.

П.С. Каже ми један млађи колега који је притом и студент да је на универзитету у Ослу већ дат ”алат” професорима који са 99% тачношћу утврђује да ли је chatGPT писао есеј.

srkiller

Čuven

- Učlanjen(a)

- 25.08.2004

- Poruke

- 1,618

- Poena

- 995

П.С. Каже ми један млађи колега који је притом и студент да је на универзитету у Ослу већ дат ”алат” професорима који са 99% тачношћу утврђује да ли је chatGPT писао есеј.

Sliku ce da skonta samo onaj ko je gledao South Park S26E04 (deep learning epizoda)... ali ako jesi, jesi mislio na "alat" sa slike? 🙂

Ko nije pogledao, a plasi ga AI, obavezno neka pogleda bar tu epizodu, vrh je...

ZorMi

Čuven

- Učlanjen(a)

- 11.08.2002

- Poruke

- 2,856

- Poena

- 875

Moja oprema

- Laptop

- HP Spectre x360 - 15-bl152nr / MS Surface Pro 3 / HP 15-dw2009nm...

- Tablet

- Samsung 8 / Xiaomi MiPad5...

- Mobilni telefon

- Samsung Galaxy A70

- Pametni uređaji

- Samsung Galaxy Watch

Xiaomi MiAir Purifier 3C

Xiaomi Mi Robot Mop...

- Pristup internetu

- Kablovski internet

- Mobilni internet

emaremare

Znamenit

- Učlanjen(a)

- 21.09.2007

- Poruke

- 6,020

- Poena

- 1,325

Jel ti izbacuje da ne moze da te ubaci na waitlistu? Pricam o Bing aplikaciji za android.Jel uspeo neko da uđe na bing-ov gpt4?

yugokoral

Cenjen

- Učlanjen(a)

- 08.12.2014

- Poruke

- 671

- Poena

- 195

Jel ti izbacuje da ne moze da te ubaci na waitlistu? Pricam o Bing aplikaciji za android.

Prilozi

ZorMi

Čuven

- Učlanjen(a)

- 11.08.2002

- Poruke

- 2,856

- Poena

- 875

Moja oprema

- Laptop

- HP Spectre x360 - 15-bl152nr / MS Surface Pro 3 / HP 15-dw2009nm...

- Tablet

- Samsung 8 / Xiaomi MiPad5...

- Mobilni telefon

- Samsung Galaxy A70

- Pametni uređaji

- Samsung Galaxy Watch

Xiaomi MiAir Purifier 3C

Xiaomi Mi Robot Mop...

- Pristup internetu

- Kablovski internet

- Mobilni internet

Negde piše da iako postoji opcija za prijavu na listu čekanja, ona više nije potrebna, nego se samo ulogujete i trebalo bi da je servis dostupan. 🤔

ZorMi

Čuven

- Učlanjen(a)

- 11.08.2002

- Poruke

- 2,856

- Poena

- 875

Moja oprema

- Laptop

- HP Spectre x360 - 15-bl152nr / MS Surface Pro 3 / HP 15-dw2009nm...

- Tablet

- Samsung 8 / Xiaomi MiPad5...

- Mobilni telefon

- Samsung Galaxy A70

- Pametni uređaji

- Samsung Galaxy Watch

Xiaomi MiAir Purifier 3C

Xiaomi Mi Robot Mop...

- Pristup internetu

- Kablovski internet

- Mobilni internet

ZorMi

Čuven

- Učlanjen(a)

- 11.08.2002

- Poruke

- 2,856

- Poena

- 875

Moja oprema

- Laptop

- HP Spectre x360 - 15-bl152nr / MS Surface Pro 3 / HP 15-dw2009nm...

- Tablet

- Samsung 8 / Xiaomi MiPad5...

- Mobilni telefon

- Samsung Galaxy A70

- Pametni uređaji

- Samsung Galaxy Watch

Xiaomi MiAir Purifier 3C

Xiaomi Mi Robot Mop...

- Pristup internetu

- Kablovski internet

- Mobilni internet

Sada su valjda pustili za sve, ali sistem nije dovoljno skaliran za tako nešto...

Žure da pokupe što više ljudi dok traje halabuka... znam mnoge koji su ismevali Internet Explorer/Edge a sada instaliraju Bing samo tako. 🙄

Žure da pokupe što više ljudi dok traje halabuka... znam mnoge koji su ismevali Internet Explorer/Edge a sada instaliraju Bing samo tako. 🙄

Poslednja izmena:

Ima nas koji koristimo Edge godinama bez obzira na ovo. 🙂Sada ima neke koristi od Edgea, zato su ljudi i počeli da ga koriste. Kada izađe alternativa Bingu, ponovo će se vratiti fokus na Chrome, Firefox i ostale.

- Učlanjen(a)

- 09.01.2011

- Poruke

- 6,692

- Poena

- 735

Ali chat.open.ai je i dalje na GPT-3 verziji, zar ne?

ZorMi

Čuven

- Učlanjen(a)

- 11.08.2002

- Poruke

- 2,856

- Poena

- 875

Moja oprema

- Laptop

- HP Spectre x360 - 15-bl152nr / MS Surface Pro 3 / HP 15-dw2009nm...

- Tablet

- Samsung 8 / Xiaomi MiPad5...

- Mobilni telefon

- Samsung Galaxy A70

- Pametni uređaji

- Samsung Galaxy Watch

Xiaomi MiAir Purifier 3C

Xiaomi Mi Robot Mop...

- Pristup internetu

- Kablovski internet

- Mobilni internet

Bing meni loše prevodi, uporno gura slovenački kada pitam nešto na srpskom, a kada ga nateram da napiše na srpskom ima dosta grešaka. ChatGPT mnogo bolji za to.

Trenutno je idealna kombinacija da se pita Bing (GPT-4, real-time data) na engleskom, pa dobijeni rezultat copy/paste u ChatGPT (GPT-3) da prevede na srpski.

Da, još uvek je besplatna verzija na GPT-3.5, dok je "Plus" verzija i plaćeni API na GPT-4.

Trenutno je idealna kombinacija da se pita Bing (GPT-4, real-time data) na engleskom, pa dobijeni rezultat copy/paste u ChatGPT (GPT-3) da prevede na srpski.

Da, još uvek je besplatna verzija na GPT-3.5, dok je "Plus" verzija i plaćeni API na GPT-4.

Poslednja izmena:

bakara

Uticajan

- Učlanjen(a)

- 22.01.2005

- Poruke

- 14,835

- Poena

- 1,555

I ja vise koristim chat GPT nego bing, i nisam bas proucavao u kakvoj su oni vezi,. Slicno jeste, isto nije.

valjda bing samo koristi njihov AI algoritam?

U pravu je @zholinho da je gugl sada preostao samo za soping nekih stvari jer pre svega sva prodaja ide preko njega.

Ali kada hoces da nesto konkretno istrazis, naucis, ili imas neku dilemu da resis, chat GPT bukvalno udara u centar iz prve.

da ne pricam ovde sada primere sta je meni sve resavao.

Moze to i gugl, ali da guglas, citas, trazis, otvoris na desetine stranica...a ovde bam iz prve.

Na kraju ce ljudi da zatupe skroz, mozak ima da nam zakrlja jer posle ovoga cemo zaboraviti i da citamo....

valjda bing samo koristi njihov AI algoritam?

U pravu je @zholinho da je gugl sada preostao samo za soping nekih stvari jer pre svega sva prodaja ide preko njega.

Ali kada hoces da nesto konkretno istrazis, naucis, ili imas neku dilemu da resis, chat GPT bukvalno udara u centar iz prve.

da ne pricam ovde sada primere sta je meni sve resavao.

Moze to i gugl, ali da guglas, citas, trazis, otvoris na desetine stranica...a ovde bam iz prve.

Na kraju ce ljudi da zatupe skroz, mozak ima da nam zakrlja jer posle ovoga cemo zaboraviti i da citamo....

Stock

Čuven

- Učlanjen(a)

- 07.09.2018

- Poruke

- 6,188

- Poena

- 685

Ali chat.open.ai je i dalje na GPT-3 verziji, zar ne?

We’re excited to bring GPT-4, our latest model, to our ChatGPT Plus subscribers.

🙂For this release, there are no updates to free accounts.

Instalacija aplikacije

How to install the app on iOS

Follow along with the video below to see how to install our site as a web app on your home screen.

Napomena: this_feature_currently_requires_accessing_site_using_safari